一封給網絡工程師的大模型指南 大型語言模型(LLMs)是怎樣學習的

親愛的網絡工程師們:

你們好!

在日常工作中,你們精通網絡架構、協議配置、流量管理與安全加固,構建并維護著數字世界的“高速公路”。當“人工智能”與“大模型”成為技術浪潮的核心時,或許你會好奇:這些看似能理解并生成人類語言的程序,究竟是如何“學習”的?它們的運作與網絡工程有何異同?這封信旨在為你提供一個清晰、直觀的解讀,將大模型的學習過程映射到你所熟悉的網絡概念中。

1. 核心類比:從“配置規則”到“學習模式”

傳統網絡管理依賴于工程師編寫的明確規則(如ACL訪問控制列表、路由協議配置)。而大型語言模型(LLMs,如GPT系列)的學習,則更像是一個基于海量數據自主歸納統計模式的過程。它不存儲固定的“規則手冊”,而是通過分析數以萬億計的文本數據(訓練數據),學習單詞、短語和概念之間的概率關聯。

網絡視角映射:你可以將其類比為一種高級的、自適應的“路由學習協議”。不是手動設定每條路徑,而是通過觀察全網流量(數據),自動學習節點(詞匯)之間最可能、最有效的連接方式(關聯關系)。

2. 學習三階段:數據、訓練與參數

a. 數據準備:構建“訓練數據集”

如同網絡設備需要輸入配置信息和流量樣本,LLMs的學習始于一個龐大、多樣的文本數據集(來自互聯網、書籍、文章等)。這個過程包括清洗(去除噪聲、錯誤)、格式化(分詞、向量化),相當于為模型準備了結構化的“學習素材”。

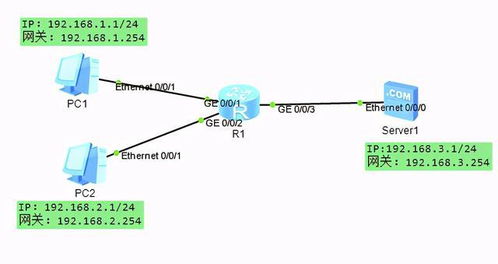

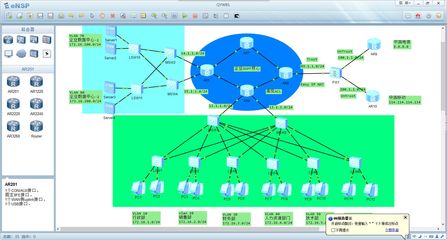

網絡視角映射:這類似于在網絡仿真或實驗室環境中,收集并預處理各種真實的網絡流量日志、協議數據包,為后續的分析或模型訓練做準備。

b. 模型訓練:調整“網絡權重”

模型的核心是一個由多層“神經元”(數學函數)構成的復雜神經網絡,其行為由數百萬甚至數千億個參數(權重)決定。訓練過程就是通過算法(如梯度下降)反復調整這些參數:

1. 模型根據當前參數對輸入文本做出預測(例如,預測句子中下一個詞)。

2. 將預測結果與真實數據(已知的下一個詞)進行比較,計算“損失值”(預測錯誤的程度)。

3. 通過反向傳播算法,將損失值沿著網絡層反向傳遞,并微調每一個參數,以減少下一次預測的損失。

這個過程在龐大的數據集上迭代數十萬甚至數百萬次。

網絡視角映射:這非常像動態路由協議(如OSPF、BGP)的收斂過程。路由器最初不知道最優路徑(參數初始化為隨機值)。通過持續交換鏈路狀態信息(輸入數據)和計算路徑開銷(計算損失),不斷更新自己的路由表(調整參數),最終整個網絡(模型)達到一個穩定、高效的狀態(收斂),能夠為數據包(新的輸入查詢)選擇最佳路徑(生成合適的文本)。

c. 模型輸出:生成與推理

訓練完成后,模型參數固定下來。當用戶輸入一個提示(prompt)時,模型根據已學習的概率分布,計算并生成最可能的詞序列作為回應。它沒有“記憶”具體訓練數據,而是基于參數所編碼的抽象模式進行“推理”。

網絡視角映射:這類似于一臺配置完成的交換機或路由器,收到一個新的數據包(用戶查詢)后,基于其轉發表或路由表(訓練好的參數),無需再次全網學習,即可迅速決策并將其轉發到正確的端口或下一跳(生成連貫的文本回復)。

3. 與網絡工程的交叉點與啟示

- 自動化與智能化:正如SDN(軟件定義網絡)和基于AI的網絡運維(AIOps)旨在讓網絡更智能、更自適應,LLMs的學習范式展示了如何通過數據驅動而非純手動規則來實現復雜系統的自動化。理解其原理,有助于你思考如何將類似的學習能力應用于網絡流量預測、異常檢測或安全策略優化。

- 數據的重要性:模型的性能極度依賴于訓練數據的質量和數量。同樣,網絡分析、策略制定和故障排查也日益依賴高質量的網絡遙測數據(Telemetry)。數據的收集、處理和分析能力是兩者共同的基礎設施。

- “黑箱”與可解釋性:LLMs的決策過程復雜,常被視為“黑箱”。網絡管理中也存在類似挑戰(如復雜的故障根因分析)。了解模型的學習機制,能幫助你更好地理解AI系統的能力邊界和潛在風險,在引入相關技術時做出更明智的決策。

- 提示工程 vs 網絡配置:與通過精確命令行配置網絡設備類似,通過精心設計提示詞(Prompt Engineering)可以更有效地“引導”LLMs輸出符合預期的結果。這是一種與智能系統交互的新技能。

###

大型語言模型的學習,本質上是利用海量數據和巨大算力,對一個超大規模參數網絡進行概率優化,從而捕獲人類語言和知識中的深層模式。它并非魔法,而是一門工程與統計相結合的精密科學。

作為一名網絡工程師,你對復雜系統、協議交互和數據流有著深刻的理解。這種系統思維正是理解AI時代的基石。希望這封信能幫助你在構建物理與虛擬網絡的也對正在重塑世界的“智能模型網絡”建立起清晰的認識。當網絡與AI更深地融合時,你的專業知識將變得更加不可或缺。

祝工作順利,探索愉快!

此致

敬禮!

一位關注技術融合的同行

---

延伸思考:你可以嘗試將你日常處理的網絡策略、QoS配置或安全規則,想象為一種需要被AI模型“學習”的模式。這或許會為你的工作帶來全新的優化視角。

如若轉載,請注明出處:http://www.51gaokao.org.cn/product/58.html

更新時間:2026-04-16 09:30:06